LaMDA, que significa Language Model for Dialogue Applications, é unha familia de modelos de linguaxe neuronal conversacional desenvolvidos por Google . A primeira xeración anunciouse durante a presentación de Google I/O de 2021, mentres que a segunda xeración anunciouse no evento do ano seguinte[1]. En xuño de 2022, LaMDA gañou unha grande atención cando o enxeñeiro de Google Blake Lemoine afirmou que o chatbot se volvera sensíbel[2][3]. A comunidade científica rexeitou en gran medida as afirmacións de Lemoine[4][5][6], aínda que provocou conversas sobre a eficacia da proba de Turing[7].

Historia

[editar | editar a fonte]Anuncios

[editar | editar a fonte]Google anunciou o modelo de linguaxe neuronal conversacional LaMDA durante a conferencia de Google I/O o 18 de maio de 2021, impulsado por intelixencia artificial.[8] Construído sobre a arquitectura de rede neuronal Transformer desenvolvida por Google Research en 2017, LaMDA formouse sobre diálogos e historias humanas, o que lle permitiu participar en conversacións abertas.[9] Google afirma que as respostas xeradas por LaMDA foron "sensatas, interesantes e específicas para o contexto".[10]

O 11 de maio de 2022, Google presentou LaMDA 2, que serve como sucesor de LaMDA, durante a presentación de Google I/O de 2022. A nova encarnación do modelo debuxa exemplos de texto de numerosas fontes, utilizándoo para formular "conversas naturais" únicas sobre temas aos que quizais non fose adestrado para responder.[11] Ademais, Google lanzou AI Test Kitchen, unha aplicación móbil impulsada por LaMDA 2 capaz de proporcionar listas de suxestións baixo demanda baseadas nun obxectivo complexo.[12][13] Orixinalmente aberta só aos empregados de Google, a aplicación estará dispoñible para "seleccionar académicos, investigadores e responsables políticos" mediante invitación nalgún momento do ano.[14]

Afirmacións sobre a consciencia

[editar | editar a fonte]

O 11 de xuño de 2022, The Washington Post informou de que o enxeñeiro de Google Blake Lemoine fora colocado nun permiso administrativo remunerado despois de que Lemoine dixese aos directivos da compañía Blaise Agüera y Arcas e Jen Gennai que LaMDA se volvera sensíbel. Lemoine chegou a esta conclusión despois de que o chatbot fixera respostas cuestionables a preguntas sobre a autoidentidade, os valores morais, a relixión e as Tres Leis da Robótica de Isaac Asimov.[16][17] Google refutou estas afirmacións, insistindo en que había probas substanciais para indicar que LaMDA non era sensíbel.[18] nunha entrevista con Wired, Lemoine reiterou as súas afirmacións de que LaMDA era "unha persoa" tal e como dita a 13ª Emenda, comparándoa cunha "intelixencia alieníxena de orixe terrestre". Ademais, revelou que fora despedido por Google despois de que contratara un avogado en nome de LaMDA[19], despois de que o chatbot pedise que Lemoine o fixera.[20]

As afirmacións de Lemoine foron amplamente rexeitadas pola comunidade científica[4]. Gary Marcus, profesor de psicoloxía que fora na Universidade de Nova York, denunciounos como "despropósitos" e subliñou que a LaMDA non tiña sentimentos nin autoconciencia. David Pfau, da empresa irmá de Google, DeepMind, e Erik Brynjolfsson, do Instituto de Intelixencia Artificial Centrada no Humano da Universidade Stanford, ridiculizaron a idea de que un modelo lingüístico poida ser sensíbel.[21] Yann LeCun, quen dirixe o equipo de investigación de IA de Meta Platforms, afirmou que as redes neuronais como LaMDA "non son o suficientemente poderosas como para acadar a verdadeira intelixencia".[22] Max Kreminski, profesor da Universidade de California, Santa Cruz, sinalou que a arquitectura de LaMDA non "soportaba algunhas capacidades clave da conciencia humana" e que os pesos da súa rede neuronal estaban "conxelados", asumindo que era un modelo típico de linguaxe ampla (large language model),[23] mentres o profesor da Universidade de Surrey, Adrian Hilton, declarou que a afirmación de que LaMDA era consciente era unha "afirmación audaz" que non estaba apoiada polos feitos.[24] O desenvolvedor principal de IBM Watson, David Ferrucci, comparou como LaMDA parecía ser humano do mesmo xeito que o fixo Watson cando se presentou por primeira vez.[25] A ex-eticista de Google AI, Timnit Gebru, chamou a Lemoine como vítima dun "ciclo de publicidade" iniciado polos investigadores e os medios.[26] As afirmacións de Lemoine tamén xeraron discusión sobre se a proba de Turing seguía sendo útil para determinar o progreso dos investigadores cara á consecución da intelixencia xeral artificial,[27] con Will Omerus, do Post, opinando que a proba mediu realmente se os sistemas de intelixencia de máquinas eran capaces de enganar aos humanos.[4]

Método

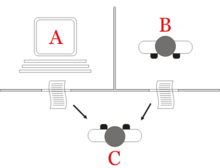

[editar | editar a fonte]LaMDA usa un modelo de linguaxe de transformador só de decodificador.[28] Está adestrado previamente nun corpus de texto que inclúe documentos e diálogos formados por 1.56 billóns de palabras,[28] e despois adestrase con datos de afinación xerados por respostas anotadas manualmente para o sentido, o interese e a seguridade.[28] As probas realizadas por Google indicaron que o LaMDA superou as respostas humanas na área de interese.[29] O modelo de transformador LaMDA e un sistema externo de recuperación de información interactúan para mellorar a precisión dos datos proporcionados ao usuario.[28]

Probáronse tres modelos diferentes, sendo o máis grande 137 mil millóns de parámetros non incorporados: [28]

| Parámetros | Capas | Unidades ( modelo d) | Cabezas |

|---|---|---|---|

| 2B | 10 | 2560 | 40 |

| 8B | 16 | 4096 | 64 |

| 137B | 64 | 8192 | 128 |

Notas

[editar | editar a fonte]- ↑ "Google vai integrar o Duo ao Meet em um único aplicativo para chamadas de vídeo; mudança acontecerá ao longo deste ano". Bolavip Brasil (en portugués). Arquivado dende o orixinal o 14 de xuño de 2022. Consultado o 2022-06-23.

- ↑ "Privileged & Confidential, Need to Know Is LaMDA Sentient? - an Interview by: lemoine@ & <collaborator>". www.documentcloud.org. Consultado o 2022-06-23.

- ↑ "Engenheiro de software do Google afirma que ferramenta de inteligência artificial da gigante de tecnologia se tornou 'consciente'". G7 News (en portugués). 2022-06-13. Consultado o 2022-06-23.

- ↑ 4,0 4,1 4,2 Business, Rachel Metz, CNN. "No, Google's AI is not sentient". CNN (en inglés). Consultado o 2022-06-23.

- ↑ "Por qué la nueva inteligencia artificial de Google ‘no es consciente’". MSN (en castelán). Consultado o 2022-06-23.

- ↑ Véliz, Carissa (2022-06-29). "Por qué el algoritmo de Google no es una persona". El País (en castelán). Consultado o 2022-06-29.

- ↑ "Analysis ; Google’s AI passed a famous test — and showed how the test is broken". Washington Post (en inglés). ISSN 0190-8286. Consultado o 2022-06-23.

- ↑ "Google I/O 2021: Google unveils LaMDA". ZDNet (en inglés). Consultado o 2022-06-23.

- ↑ "Artificial neural networks are making strides towards consciousness, according to Blaise Agüera y Arcas". The Economist. ISSN 0013-0613. Consultado o 2022-06-23.

- ↑ "LaMDA: Towards Safe, Grounded, and High-Quality Dialog Models for Everything". Google AI Blog (en inglés). Consultado o 2022-06-23.

- ↑ "Google details its latest language model and AI Test Kitchen". TechCrunch (en inglés). Consultado o 16 de novembro de 2023.

- ↑ "Google’s AI Test Kitchen lets you experiment with its natural language model". Engadget (en inglés). Consultado o 2022-06-23.

- ↑ Vincent, James (2022-05-11). "Google is beta testing its AI future". The Verge (en inglés). Consultado o 2022-06-23.

- ↑ Bhattacharya, Ananya. "Google is so nervous about what its newest bot will say, it made the app invitation-only". Quartz (en inglés). Consultado o 2022-06-23.

- ↑ "No, a Google chatbot A.I. did not become 'sentient.' But the case is nonetheless telling.". Fortune (en inglés). Consultado o 2022-06-23.

- ↑ "The Google engineer who thinks the company’s AI has come to life". Washington Post (en inglés). ISSN 0190-8286. Consultado o 2022-06-23.

- ↑ "Google engineer put on leave after saying AI chatbot has become sentient". the Guardian (en inglés). 2022-06-12. Consultado o 2022-06-23.

- ↑ Vlamis, Kelsey. "Read the conversations that helped convince a Google engineer an artificial intelligence chatbot had become sentient: 'I am often trying to figure out who and what I am'". Business Insider (en inglés). Consultado o 2022-06-23.

- ↑ @Alvy. "Ahora sí que la fastidiamos, porque LaMDA, la supuesta inteligencia sintiente de Google, ha contratado un abogado para defender sus derechos". Microsiervos (en castelán). Consultado o 2022-06-23.

- ↑ Levy, Steven. "Blake Lemoine Says Google's LaMDA AI Faces 'Bigotry'". Wired (en inglés). ISSN 1059-1028. Consultado o 2022-06-23.

- ↑ "No, a Google chatbot A.I. did not become 'sentient.' But the case is nonetheless telling.". Fortune (en inglés). Consultado o 2022-06-23.

- ↑ Grant, Nico; Metz, Cade (2022-06-12). "Google Sidelines Engineer Who Claims Its A.I. Is Sentient". The New York Times (en inglés). ISSN 0362-4331. Consultado o 2022-06-23.

- ↑ "Google Debate Over ‘Sentient’ Bots Overshadows Deeper AI Issues". Bloomberg.com (en inglés). 2022-06-14. Consultado o 2022-06-23.

- ↑ "Has Google's LaMDA artificial intelligence really achieved sentience?". New Scientist (en inglés). Consultado o 2022-06-23.

- ↑ "AI Weekly: LaMDA’s ‘sentient’ AI debate triggers memories of IBM Watson". VentureBeat (en inglés). 2022-06-16. Consultado o 2022-06-23.

- ↑ Johnson, Khari. "LaMDA and the Sentient AI Trap". Wired (en inglés). ISSN 1059-1028. Consultado o 2022-06-23.

- ↑ "No, a Google chatbot A.I. did not become 'sentient.' But the case is nonetheless telling.". Fortune (en inglés). Consultado o 2022-06-23.

- ↑ 28,0 28,1 28,2 28,3 28,4 Thoppilan et al. 2022.

- ↑ Hager, Ryne (2022-06-16). "How Google's LaMDA AI works, and why it seems so much smarter than it is". Android Police (en inglés). Consultado o 2022-06-23.

Véxase tamén

[editar | editar a fonte]| Wikimedia Commons ten máis contidos multimedia na categoría: LaMDA |

- Intelixencia artificial

- Argumento da sala chinesa

- Procesamento da linguaxe natural

- Test de Turing

- Máquina de Voight-Kampff